Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Este guia descreve as principais decisões para distribuir o Azure AI Foundry, incluindo configuração de ambiente, isolamento de dados, integração com outros serviços do Azure, gerenciamento de capacidade e monitoramento. Cada organização é diferente. Use este guia como ponto de partida e adapte-o às suas necessidades. Para obter detalhes sobre a implementação, consulte os artigos vinculados para obter mais diretrizes.

Organização de exemplo

A Contoso é uma empresa global que explora a adoção do GenAI em cinco grupos de negócios, cada um com necessidades distintas e maturidade técnica.

Para acelerar a adoção e manter a supervisão, a Contoso Enterprise IT tem como objetivo habilitar um modelo com recursos compartilhados comuns, incluindo rede e gerenciamento centralizado de dados, ao mesmo tempo em que permite o acesso de autoatendimento à AI Foundry para cada equipe em um ambiente seguro e controlado para gerenciar seus casos de uso.

Considerações sobre implementação

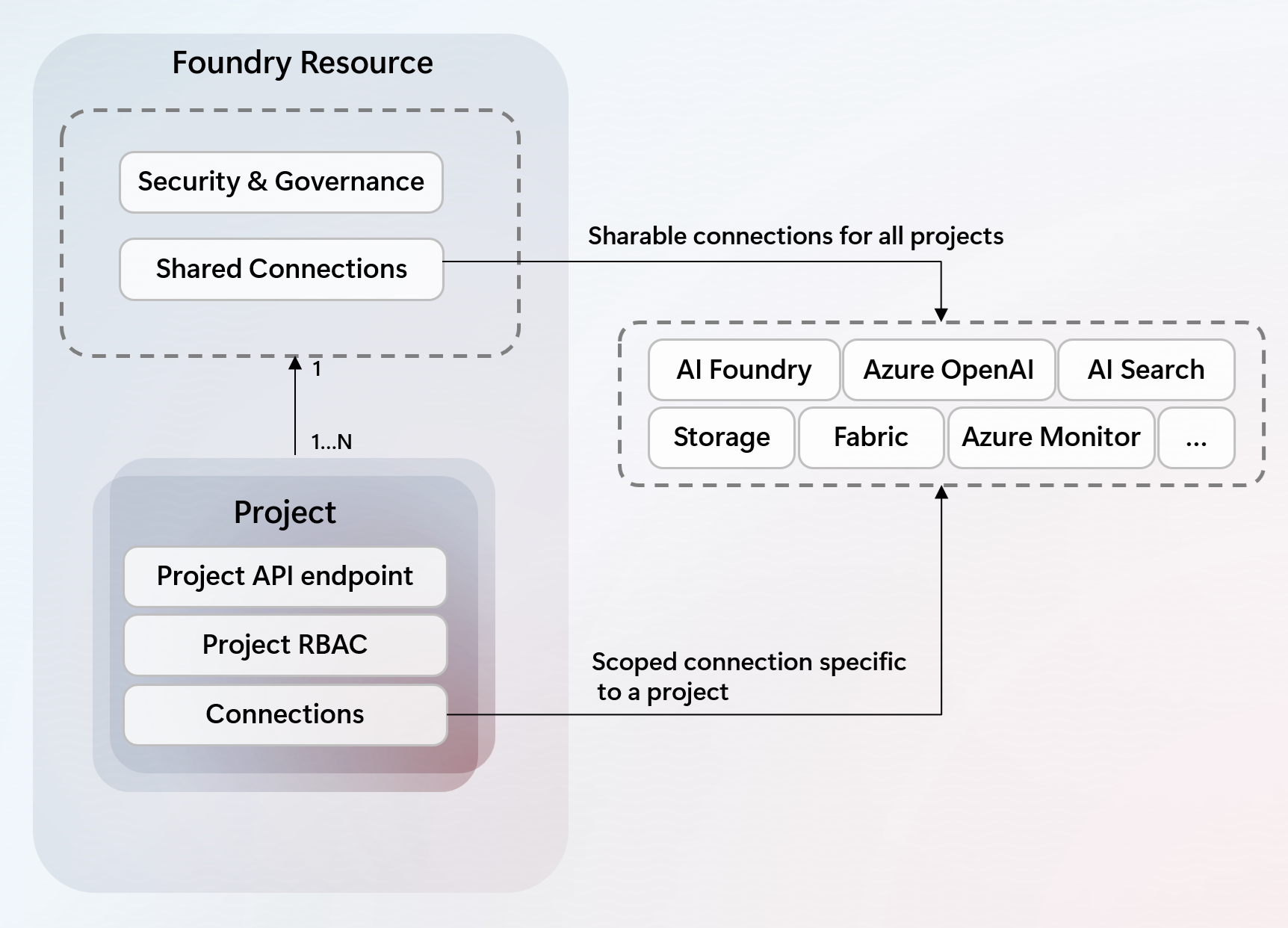

O recurso Azure AI Foundry define o escopo para configurar, proteger e monitorar o ambiente da sua equipe. Projetos são como pastas para organizar seu trabalho nesse contexto de recurso. Os projetos também concedem acesso às APIs e ferramentas de desenvolvedor do Foundry.

Para garantir a consistência, a escalabilidade e a governança entre as equipes, considere as seguintes práticas de configuração de ambiente ao distribuir o Azure AI Foundry:

Estabelecer ambientes distintos para desenvolvimento, teste e produção Use grupos de recursos ou assinaturas separados e recursos do AI Foundry para isolar fluxos de trabalho, gerenciar o acesso e dar suporte à experimentação com versões controladas.

Criar um recurso separado do Azure AI Foundry para cada grupo de negócios Alinhe as implantações com limites lógicos, como domínios de dados ou funções de negócios, para garantir a autonomia, a governança e o acompanhamento de custos.

Definir um projeto por caso de uso Os projetos Foundry foram projetados para representar um caso de uso específico. São contêineres para organizar componentes como agentes, arquivos, para um aplicativo. Embora herdem as configurações de segurança do recurso pai, elas também implementam seus próprios controles de acesso, integração de dados e outros controles de governança.

Protegendo o ambiente de AI Foundry

A AI Foundry é criada na plataforma do Azure, permitindo que você personalize os controles de segurança para atender às necessidades da sua organização. As principais áreas de configuração incluem:

Identidade: Use o Microsoft Entra ID para gerenciar o acesso de usuários e serviços. A AI Foundry dá suporte a identidades gerenciadas para permitir a autenticação segura e sem senha para outros serviços do Azure. As identidades gerenciadas podem ser atribuídas no nível de recurso do AI Foundry e, opcionalmente, no nível do projeto para controle refinado. Saiba mais sobre identidades gerenciadas..

Rede: implantar a AI Foundry em uma VNet (Rede Virtual) para isolar o tráfego e controlar o acesso usando NSGs (Grupos de Segurança de Rede). Saiba mais sobre segurança de rede..

Customer-Managed Keys (CMK): o Azure dá suporte ao CMK para criptografar dados inativos. A AI Foundry dá suporte ao CMK opcionalmente para clientes com necessidades estritas de conformidade. Saiba mais sobre o CMK.

Autenticação &autorização: a AI Foundry dá suporte ao acesso baseado em chave da API para integração simples e RBAC do Azure para controle refinado. O Azure impõe uma separação clara entre o plano de controle (gerenciamento de recursos) e o plano de dados (modelo e acesso a dados). Comece com funções internas e defina funções personalizadas conforme necessário. Saiba mais sobre autenticação..

Templates: utilize ARM templates ou Bicep para automatizar implantações seguras. Explore os modelos de exemplo.

Recurso de armazenamento: você pode optar por usar recursos de armazenamento internos no AI Foundry ou usar seus próprios recursos de armazenamento. Em particular para serviços do Agente, threads e mensagens podem, opcionalmente, ser armazenados em recursos gerenciados por você.

Exemplo: abordagem de segurança da Contoso

A Contoso protege suas implantações da AI do Foundry usando rede privada com a TI Enterprise gerenciando uma rede de hub central e cada grupo de negócios se conectando por meio de uma VNet de spoke. Eles usam o RBAC (controle de acesso baseado em função) internas para separar o acesso:

- Administradores gerenciam implantações/conexões/recursos compartilhados

- Os Gerentes de Projeto supervisionam projetos específicos

- Os usuários interagem com as ferramentas do GenAI

Para a maioria dos casos de uso, a Contoso não usa chaves Customer-Managed, dependendo da criptografia gerenciada pela Microsoft por padrão.

Planejar o acesso do usuário

O gerenciamento de acesso efetivo é fundamental para uma configuração segura e escalonável da AI Foundry.

-

Definir funções e responsabilidades de acesso necessárias

- Identifique quais grupos de usuários exigem acesso a vários aspectos do ambiente do AI Foundry.

- Atribua funções internas ou personalizadas do RBAC do Azure com base em responsabilidades como:

- Proprietário da conta: gerencie configurações de nível superior, como segurança e conexões de recursos compartilhados.

- Gerentes de Projeto: crie e gerencie projetos do AI Foundry e seus colaboradores.

- Usuários do Projeto: contribuam para projetos existentes.

-

Determinar o escopo de acesso

- Escolha o escopo apropriado para atribuições de acesso:

- Nível de assinatura: acesso mais amplo, normalmente adequado para equipes centrais de TI ou plataforma ou organizações menores.

- Nível do grupo de recursos: útil para agrupar recursos relacionados com políticas de acesso compartilhado. Por exemplo, uma Função do Azure que segue o mesmo ciclo de vida do aplicativo que seu ambiente de AI Foundry.

- Nível de projeto ou recurso: ideal para controle refinado, especialmente ao lidar com dados confidenciais ou habilitar o autoatendimento.

- Escolha o escopo apropriado para atribuições de acesso:

-

Alinhar a estratégia de identidade

- Para fontes de dados e ferramentas integradas ao AI Foundry, determine se os usuários devem se autenticar usando:

- Usando identidades gerenciadas ou chave de API: adequado para serviços automatizados e acesso compartilhado entre usuários.

- Identidades de usuário: preferencialmente quando a responsabilidade ou a auditoria no nível do usuário são necessárias.

- Use grupos de ID do Microsoft Entra para simplificar o gerenciamento de acesso e garantir a consistência entre ambientes.

- Para fontes de dados e ferramentas integradas ao AI Foundry, determine se os usuários devem se autenticar usando:

Estabelecer conectividade com outros serviços do Azure

O Azure AI Foundry dá suporte a conexões, que são configurações reutilizáveis que permitem o acesso aos componentes do aplicativo nos serviços do Azure e não do Azure. Essas conexões também atuam como agentes de identidade, permitindo que o Foundry se autentique em sistemas externos usando identidades gerenciadas ou entidades de serviço em nome de usuários do projeto.

As conexões podem ser criadas no nível de recurso do AI Foundry , ideal para serviços compartilhados como o Armazenamento do Azure ou o Key Vault, ou com escopo para um projeto específico, que é recomendado para integrações confidenciais ou específicas do projeto. Essa flexibilidade permite que as equipes balanceiem a reutilização e o isolamento com base em suas necessidades. Saiba mais sobre conexões na AI Foundry.

A autenticação de conexão pode usar tokens de acesso compartilhado, como identidades gerenciadas do Microsoft Entra ID ou chaves de API, para simplificar o gerenciamento e a integração, ou tokens de usuário por meio da passagem pelo Entra ID, que oferecem maior controle ao acessar fontes de dados sensíveis.

Exemplo: a estratégia de conectividade da Contoso

- A Contoso cria um recurso do Azure AI Foundry para cada grupo de negócios, garantindo que projetos com necessidades de dados semelhantes possam compartilhar os mesmos recursos conectados.

- Por padrão, os recursos conectados usam tokens de autenticação compartilhada e são compartilhados em todos os projetos.

- Projetos que usam cargas de trabalho de dados confidenciais, conectam-se à fonte de dados com conexões com escopo de projeto e autenticação de passagem da EntraID.

Governance

A governança efetiva no Azure AI Foundry garante operações seguras, compatíveis e econômicas entre grupos de negócios.

- Controle de acesso de modelo com o Azure Policy O Azure Policy permite que você aplique regras em recursos do Azure. Na AI Foundry, você pode usar políticas para restringir quais modelos ou famílias de modelos grupos de negócios específicos podem acessar. Exemplo: o grupo Finance &Risk da Contoso é impedido de usar modelos de versão prévia ou não compatíveis aplicando uma política no nível de assinatura do grupo de negócios.

- Gerenciamento de Custos por Grupo Empresarial Ao implantar o AI Foundry por grupo de negócios, a Contoso pode acompanhar e gerenciar custos de forma independente. Use o Gerenciamento de Custos da Microsoft para exibir o uso e os gastos detalhados por implantação ou projeto do Foundry.

- Acompanhamento de uso com o Azure Monitor O Azure Monitor fornece métricas e dashboards para acompanhar padrões de uso, desempenho e integridade dos recursos do AI Foundry.

- O registro em log detalhado com o Azure Log Analytics do Azure Log Analytics permite uma inspeção profunda de logs para insights operacionais. Por exemplo, registro de uso de solicitações, uso de token e latência para acompanhamento de auditoria e otimização.

Configurar e otimizar implantações de modelo

Ao implantar modelos na AI Foundry, as equipes podem escolher entre tipos de implantação padrão e provisionados. As implantações padrão são ideais para desenvolvimento e experimentação, oferecendo flexibilidade e facilidade de instalação. Implantações provisionadas são recomendadas para cenários de produção em que o desempenho previsível, o controle de custo e a fixação de versão do modelo são necessários.

Para dar suporte a cenários entre regiões e permitir que você acesse implantações de modelo existentes, o AI Foundry permite conexões com implantações de modelo hospedadas em outras instâncias do Foundry ou do Azure OpenAI. As conexões permitem que as equipes centralizem implantações para experimentação e, ao mesmo tempo, habilitem o acesso de projetos distribuídos. Para cargas de trabalho de produção, considere casos de uso para gerenciar suas próprias implantações para garantir um controle mais rígido sobre o ciclo de vida do modelo, o controle de versão e as estratégias de reversão.

Para evitar o uso excessivo e garantir uma alocação justa de recursos, você pode aplicar limites de TPM (Tokens por Minuto) no nível de implantação. Os limites do TPM ajudam a controlar o consumo, proteger contra picos acidentais e alinhar o uso com orçamentos ou cotas de projeto. Considere a definição de limites conservadores para implantações compartilhadas e limites mais altos para serviços críticos de produção.

Acessar a funcionalidade estendida com o Hub de IA do Azure

Embora apenas um recurso do Azure AI Foundry forneça acesso à maioria das funcionalidades do AI Foundry, os recursos selecionados estão disponíveis apenas em combinação com um recurso do hub de IA do Azure alimentado pelo Azure Machine Learning. Essas são funcionalidades mais baixas na pilha de desenvolvimento de IA, focada na personalização do modelo.

Os recursos do hub exigem seus próprios tipos de projeto que também podem ser acessados usando o Azure Machine Learning Studio/SDK/CLI. Para ajudar a planejar sua implantação, consulte esta tabela e escolha um tipo de recurso para obter uma visão geral dos recursos com suporte.

Um recurso de hub é implantado lado a lado com o recurso AI Foundry e usa uma dependência do recurso AI Foundry para fornecer acesso a ferramentas e modelos selecionados.

Saiba Mais

Proteger o ambiente de AI Foundry

- Autenticação &RBAC: controle de acesso baseado em função no Azure AI Foundry

- Identidade &Identidade Gerenciada: Configurar identidade gerenciada no Azure AI Foundry

- Customer-Managed Keys (CMK): chaves gerenciadas pelo cliente no Azure AI Foundry

- Exemplo de repositório de modelos de infraestrutura com modelos de infraestrutura de exemplo

- Recuperar ou limpar recursos excluídos do Azure AI Foundry

Estabelecer conectividade com outros serviços do Azure

- Visão geral das conexões: adicionar uma nova conexão no Azure AI Foundry

Governance

- Controle de acesso de modelo com o Azure Policy: controle a implantação de modelo com políticas internas

- Gerenciamento de Custos: Planejar e gerenciar custos para o Azure AI Foundry

- Azure Monitor para Acompanhamento de Uso: monitorar seus aplicativos de IA generativos