Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

A IA generativa (GenAI) está sendo adotada a uma taxa sem precedentes à medida que as organizações se envolvem ou experimentam ativamente com o GenAI em várias capacidades. As equipes de segurança podem atenuar e gerenciar riscos de forma mais eficaz, ganhando proativamente visibilidade do uso de IA dentro da organização e implementando controles correspondentes. Este artigo descreve como descobrir o uso do aplicativo de IA em sua organização, incluindo avaliar o risco para seus dados confidenciais.

Este é o segundo artigo de uma série. Antes de usar este artigo, certifique-se de realizar as tarefas no Prepare for AI security para preparar seu ambiente com recursos prescritos neste artigo.

A Microsoft fornece ferramentas para ajudá-lo a obter visibilidade dos riscos de dados, acesso, usuário e aplicativo para a IA que você compila e usa. Esses recursos ajudam você a lidar proativamente com vulnerabilidades enquanto cria uma postura de segurança forte para IA.

A tabela a seguir descreve a ilustração e também percorre as etapas de implementação dessas funcionalidades.

| Passo | Tarefa | Escopo |

|---|---|---|

| 1 | Obtenha visibilidade de todas as identidades de agente criadas no Microsoft Copilot Studio e no Azure AI Foundry por meio do Microsoft Entra Agent ID. | Agentes criados no Microsoft Copilot Studio e no Azure AI Foundry |

| 2 | Obtenha visibilidade do uso de IA com o DSPM (Gerenciamento de Postura de Segurança de Dados) do Microsoft Purview para IA. Aplique políticas para proteger dados confidenciais. | Copilotos, agentes e outros aplicativos de IA que usam LLMs (grandes modelos de linguagem) de terceiros, incluindo sites de IA com suporte. |

| 3 | Descobrir, sancionar e bloquear aplicativos de IA com o Microsoft Defender para Aplicativos de Nuvem | Aplicativos SaaS de IA |

| 4 | Descubra cargas de trabalho de IA implantadas em seu ambiente e obtenha insights de segurança com o Microsoft Defender para O CSPM (Gerenciamento de Postura de Segurança na Nuvem) | Aplicativos de IA personalizados construídos com o Azure AI |

Etapa 1 – Obter visibilidade dos agentes com a ID do Agente do Entra (Versão preliminar)

À medida que as organizações criam e adotam agentes de IA, é desafiador acompanhar esses atores não humanos. A mesma coisa que torna esses agentes poderosos, sua capacidade de lidar com tarefas complexas de forma autônoma e agir como colegas de equipe virtuais, também levanta preocupações. É por isso que é essencial rastrear identidades de agente, gerenciar seu ciclo de vida e permissões e proteger cuidadosamente o acesso deles aos recursos da sua organização.

A ID do Agente do Microsoft Entra (versão prévia) fornece um diretório unificado de todas as identidades de agente criadas no Microsoft Copilot Studio e no Azure AI Foundry. Esta é uma primeira etapa para proporcionar visibilidade, proteção e governança ainda maiores do volume de agentes em rápido crescimento nas organizações.

| Tarefa | Recursos recomendados |

|---|---|

| Exibir todos os agentes em sua organização | entre no Centro de administração do Microsoft Entra e navegue até aplicativos Empresariais. Na barra de filtros no topo da exibição de lista, configure o menu suspenso de Tipo de Aplicativo para ID do Agente (Versão preliminar). Instantaneamente, sua lista de aplicativos empresariais será reduzida para mostrar os agentes de IA (criados por meio do Copilot Studio ou do Azure AI Foundry) que estão registrados em seu locatário. |

| Saiba mais examinando este blog | Anunciando Microsoft Entra Agent ID: gerencie e proteja seus agentes de IA |

Etapa 2 – Obter visibilidade do uso de IA com o DSPM (Gerenciamento de Postura de Segurança de Dados) para IA

O DSPM (Gerenciamento de Postura de Segurança de Dados) do Microsoft Purview para IA se concentra em como a IA é usada em sua organização, especialmente como seus dados interagem com as ferramentas de IA. Ele funciona com sites de IA generativa. DSPM para IA fornece insights mais profundos sobre os Copilotos da Microsoft e aplicativos SaaS de terceiros, como ChatGPT Enterprise e Google Gemini.

O diagrama a seguir mostra uma das visões agregadas sobre o impacto do uso da IA em seus dados: interações confidenciais por aplicativo de IA generativa.

O DSPM para IA oferece um conjunto de recursos que ajudam você a adotar a IA com segurança sem precisar escolher entre produtividade e proteção:

- Insights e análises sobre a atividade de IA na sua organização

- Políticas prontas a utilizar para proteger dados e evitar a perda de dados em pedidos de IA

- Avaliações de risco de dados para identificar, corrigir e monitorar o possível compartilhamento excessivo de dados

- Ações recomendadas com base nos dados do seu locatário

- Controlos de conformidade para aplicar políticas de armazenamento e processamento de dados ideais

Para monitorar interações com sites de IA de terceiros, os dispositivos devem ser integrados ao Microsoft Purview. Se você seguiu as diretrizes em Preparar para a segurança de IA, registrou dispositivos no gerenciamento com o Microsoft Intune e, posteriormente, adicionou esses dispositivos ao Defender para Endpoint. A incorporação de dispositivos é compartilhada no Microsoft 365 (incluindo o Microsoft Purview) e no Microsoft Defender para Endpoint (MDE).

Use os recursos a seguir para descobrir aplicativos e dados de IA com o DSPM para IA.

| Tarefa | Recursos recomendados |

|---|---|

| Verifique se os dispositivos estão integrados ao Microsoft Purview. | Se os dispositivos ainda não estiverem integrados ao Defender para Endpoint, há vários métodos disponíveis para integrá-los. Veja, integrar dispositivos Windows no Microsoft 365. |

| Entender os pré-requisitos e como funciona o DSPM para IA | Considerações para implantar o Gerenciamento de Postura de Segurança de Dados do Microsoft Purview para IA |

| Começar a usar o DSPM para IA | Como usar o Gerenciamento de Postura de Segurança de Dados para IA |

| Examinar sites de IA com suporte | Sites de IA com suporte do Microsoft Purview para proteções de conformidade e segurança de dados |

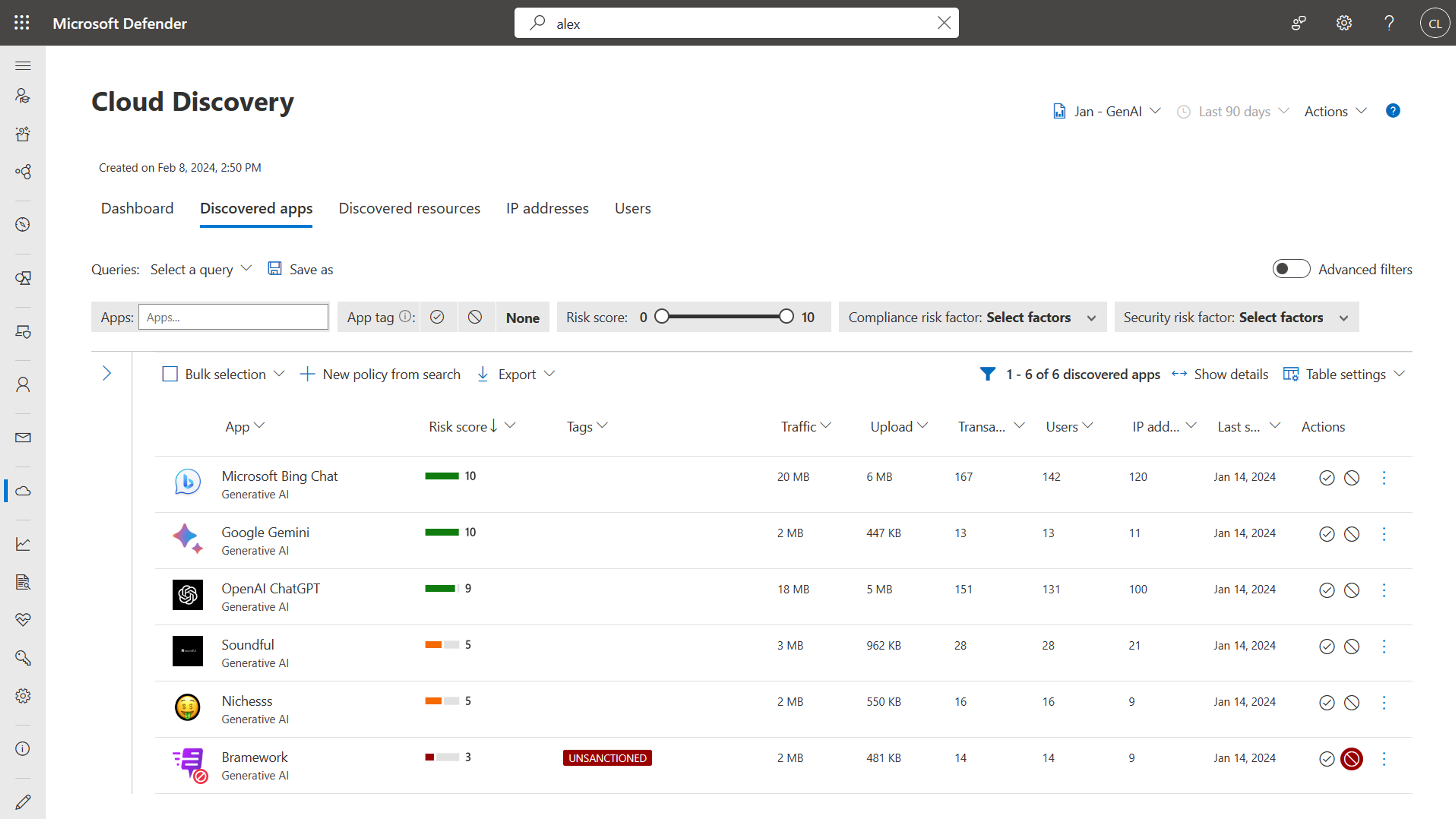

Etapa 3 – Descobrir, sancionar e bloquear aplicativos de IA com o Microsoft Defender para Aplicativos de Nuvem

O Microsoft Defender para Aplicativos de Nuvem ajuda as equipes de segurança a descobrir o uso e os aplicativos SaaS GenAI.

O catálogo de aplicativos do Defender para Aplicativos de Nuvem inclui uma categoria de IA Generativa para aplicativos LLM (modelo de linguagem grande), como o Microsoft Bing Chat, o Google Bard, o ChatGPT e muito mais. O Defender para Aplicativos de Nuvem adicionou mais de mil aplicativos relacionados à IA generativos ao catálogo, fornecendo visibilidade de como os aplicativos de IA generativos são usados em sua organização e ajudando você a gerenciá-los com segurança.

Com o Defender para Aplicativos de Nuvem, você pode:

- Filtrar nos aplicativos de IA Generativa

- Descubra os aplicativos de IA que são usados em sua organização

- Exibir avaliações de risco prontas para cada aplicativo, incluindo mais de 90 fatores de risco em conformidade regulatória e de segurança

- Sancionar ou desanexar (bloquear) o uso de aplicativos específicos

- Crie políticas que continuam a descobrir aplicativos de IA com base em critérios definidos, incluindo pontuação de risco, número de usuários por dia e outros. Você pode até mesmo cancelar automaticamente aplicativos que atendem aos critérios.

Use os recursos a seguir para as próximas etapas.

| Tarefa | Recursos recomendados |

|---|---|

| Pilote e implante o Defender para Aplicativos de Nuvem | Como fazer para piloto e implantar o Microsoft Defender para Aplicativos de Nuvem? |

| Examine este tutorial de vídeo | Descobrir quais aplicativos de IA generativos são usados em seu ambiente usando o Defender para aplicativos de nuvem |

| Exibir aplicativos descobertos | Exibir aplicativos descobertos com o painel de descoberta de nuvem |

| Localizar seu aplicativo de nuvem e calcular a pontuação de risco | Catálogo de aplicativos de nuvem e pontuações de risco – Microsoft Defender para Aplicativos na Nuvem |

| Controlar aplicativos descobertos | Governar aplicativos descobertos – Microsoft Defender para Aplicativos de Nuvem |

Etapa 4 – Descobrir cargas de trabalho de IA implantadas em seu ambiente e obter insights de segurança com o Microsoft Defender para Nuvem

O plano CSPM (Gerenciamento de Postura e Segurança na Nuvem) do Defender no Microsoft Defender para Nuvem fornece recursos de gerenciamento de postura de segurança de IA, começando com a descoberta de Aplicativos de IA criados em seus ambientes:

- Descobrindo a lista de materiais de IA generativa, que inclui componentes do aplicativo, dados e artefatos de IA do código para a nuvem.

- Fortalecendo a postura de segurança de aplicativos de IA generativa com recomendações internas e explorando e corrigindo riscos de segurança.

- Usando a análise do caminho de ataque para identificar e corrigir os riscos.

Use o gerenciador de segurança de nuvem para identificar cargas de trabalho e modelos de IA geradores em execução em seu ambiente. O Gerenciador de Segurança de Nuvem inclui consultas pré-configuradas:

- Cargas de trabalho e modelos de IA em uso

- Repositórios de código vulneráveis à IA de geração que provisionam o Azure OpenAI

- Contêineres que executam imagens de contêiner com vulnerabilidades de IA generativas conhecidas.

Você também pode configurar suas próprias consultas.

Use os recursos a seguir para as próximas etapas.

| Tarefa | Recursos recomendados |

|---|---|

| Saiba mais sobre o gerenciamento de postura de segurança de IA | Gerenciamento de postura de segurança de IA com o Defender para Nuvem |

| Descobrir cargas de trabalho de IA | Cargas de trabalho e modelos de IA em uso |

| Explorar riscos na pré-implantação de artefatos gerativos de IA | Riscos para pré-implantação de artefatos de IA gerativos |

Próxima etapa para proteger a IA

Depois de descobrir o uso de IA em sua organização, a próxima etapa é aplicar proteções:

- Proteger dados confidenciais usados com aplicativos de IA

- Implementar a proteção contra ameaças especificamente para uso de IA

Confira o próximo artigo desta série: Como proteger minha organização ao usar aplicativos de IA?