Observação

O acesso a essa página exige autorização. Você pode tentar entrar ou alterar diretórios.

O acesso a essa página exige autorização. Você pode tentar alterar os diretórios.

Este artigo descreve como usar recursos específicos para proteger aplicativos de IA e os dados com os quais eles interagem.

- Proteger seus dados confidenciais em prompts de usuário e dados gerados por IA

- Defender contra ameaças emergentes, como injeções de prompt

Este é o terceiro artigo de uma série. Se você ainda não realizou as tarefas em Preparar para segurança de IA e descobrir aplicativos e dados de IA, comece com esses artigos para preparar seu ambiente com recursos prescritos neste artigo.

Use este artigo junto com este recurso:

- CAF (Cloud Adoption Framework) para IA — Processo para proteger a IA

A Microsoft fornece um amplo conjunto de recursos para proteger dados e aplicativos de IA. Este artigo discute isso em duas categorias: proteção de dados e proteção contra ameaças.

As duas tabelas a seguir descrevem a ilustração e também percorrem as etapas de implementação dessas funcionalidades.

Tabela 1 – Recursos de proteção de dados

| Passo | Tarefa | Escopo |

|---|---|---|

| 1 | Aplique controles de compartilhamento excessivo do SharePoint para isentar rapidamente sites confidenciais e dados do escopo de aplicativos de IA. | Sites e arquivos em seu ambiente do Microsoft 365. |

| 2 | Use o DSPM (Gerenciamento de Postura de Segurança de Dados) para IA para saber onde o compartilhamento excessivo está ocorrendo e para encontrar lacunas na cobertura da política para rótulos de confidencialidade e políticas DLP. | Copilotos, agentes e outros aplicativos de IA que usam LLMs (grandes modelos de linguagem) de terceiros, incluindo sites de IA com suporte. Aplicativos de IA em outros provedores de nuvem por meio do SDK do Purview. |

| 3 | Continue progredindo em rótulos de confidencialidade e políticas de prevenção contra perda de dados (DLP). | Sites, arquivos e dispositivos em seu ambiente do Microsoft 365. Aplicativos SaaS quando integrados ao Defender para Aplicativos de Nuvem. Aplicativos de IA no Azure e em outros provedores de nuvem por meio do SDK do Purview. |

| 4 | No IRM (Insider Risk Management), aplique o modelo de IA arriscado para identificar o comportamento arriscado em aplicativos de IA. | Sites de IA generativos. Microsoft 365 Copilot, Microsoft Copilot, Copilot Studio, serviços de IA do Azure. Aplicativos de IA em outros provedores de nuvem por meio do SDK do Purview. |

| 5 | Configurar a Proteção Adaptável para o Gerenciamento de Riscos Internos para aumentar a proteção de dados com base no risco dos usuários | Sites, arquivos e dispositivos em seu ambiente do Microsoft 365. |

Tabela 2 – Funcionalidades de proteção contra ameaças

| Passo | Tarefa | Escopo |

|---|---|---|

| 1 | Use o Defender para Aplicativos de Nuvem para alertá-lo quando novos aplicativos de IA estão sendo usados, para calcular as pontuações de risco para aplicativos de IA e para permitir ou bloquear esses aplicativos em seu ambiente. O Defender para Aplicativos de Nuvem fornece proteções extras para o Microsoft 365 Copilot. | Aplicativos SaaS de IA |

| 2 | Defender para Nuvem Descubra cargas de trabalho de IA implantadas em seu ambiente e obtenha insights de segurança com o Microsoft Defender para Nuvem |

Aplicativos de IA personalizados construídos com o Azure AI |

Proteger dados de IA

Esses recursos ajudam você a aprender e atenuar com eficiência os principais riscos associados ao compartilhamento excessivo de dados, ao uso de dados confidenciais e aos comportamentos arriscados dos usuários. Esses recursos têm como escopo proteções para aplicativos e dados de IA em seu ambiente.

Etapa 1 – Aplicar controles de compartilhamento excessivo do SharePoint

Os controles de compartilhamento excessivo do SharePoint incluem controles integrados ao SharePoint, como permissões com escopo, e recursos de complemento no Gerenciamento Avançado do SharePoint para reforçar a governança de conteúdo para o percurso de implantação do Microsoft Copilot. Os controles de compartilhamento excessivo do SharePoint ajudam você a:

- Limite temporariamente a pesquisa do Copilot a uma lista de sites especificados (Pesquisa Restrita do SharePoint).

- Identifique rapidamente sites que potencialmente contêm dados compartilhados ou conteúdo confidencial (relatórios de governança de acesso a dados).

- Sinalizar sites para que os usuários não possam encontrá-los por meio do Copilot ou da pesquisa em toda a organização (Descoberta restrita de conteúdo no Gerenciamento Avançado do SharePoint).

- crie políticas de site inativas para gerenciar e reduzir automaticamente sites inativos (Gerenciamento Avançado do SharePoint).

- Restrinja o acesso a sites do SharePoint e do OneDrive a usuários em um grupo específico (políticas de controle de acesso restrito no Gerenciamento Avançado do SharePoint).

Para começar a usar controles de compartilhamento excessivo, use os recursos a seguir.

| Tarefa | Recursos recomendados |

|---|---|

| Examine a ilustração e a descrição dos controles de compartilhamento excessivo que você pode usar com o Microsoft 365 Copilot | Arquitetura de auditoria e proteção de dados do Microsoft 365 Copilot |

| Modelo disponível para download para impedir o compartilhamento excessivo | Plano do Microsoft 365 Copilot para compartilhamento excessivo |

| Saiba mais sobre o Gerenciamento Avançado do SharePoint | Microsoft SharePoint Premium - visão geral do Gerenciamento Avançado do SharePoint |

Etapa 2– Proteger dados por meio do DSPM para IA

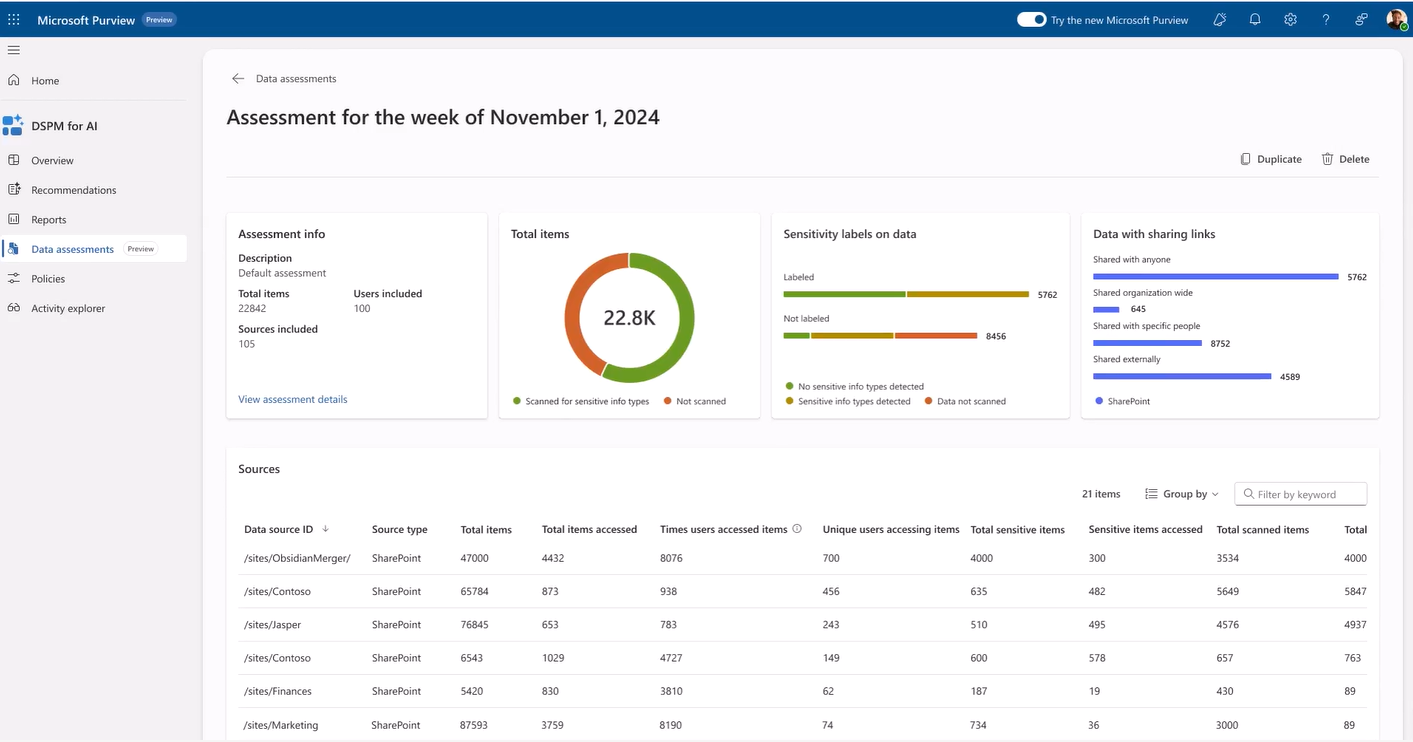

Use o DSPM para IA para saber onde o compartilhamento excessivo está ocorrendo e para encontrar lacunas na cobertura da política para rótulos de confidencialidade e políticas DLP.

Um ótimo lugar para começar é com o Relatório de Avaliação da Semana.

Você pode analisar relatórios individuais para saber mais sobre onde você tem lacunas em controles de compartilhamento excessivo, rótulos e políticas DLP para que você possa corrigir rapidamente esses problemas.

Para cada relatório, o DSPM para IA fornece recomendações para melhorar a segurança de dados. Use o link Exibir todas as recomendações ou Recomendações do painel de navegação para ver todas as recomendações disponíveis para seu locatário e seu status.

Use os recursos a seguir para proteger aplicativos e dados de IA com O DSPM para IA.

| Tarefa | Recursos recomendados |

|---|---|

| Saiba mais sobre DSPM para IA | Como usar o DSPM para IA |

| Saiba mais sobre os pré-requisitos e como funcionam as políticas de um clique e as políticas padrão | Considerações sobre o DSPM para IA |

| Para aplicativos de IA em outros provedores de nuvem, saiba como testar a integração com o DSPM para IA usando o SDK do Purview | Como testar um aplicativo de IA integrado ao SDK do Purview |

Etapa 3 – Continuar a identificar lacunas em rótulos de confidencialidade e políticas DLP

No Prepare for AI Security, você usou as ferramentas de gerenciamento de postura de segurança de dados do Microsoft Purview, DSPM e DSPM para IA, para priorizar a proteção de seus dados confidenciais. Continue revisitando essas ferramentas para identificar lacunas na cobertura da política e descobrir onde você precisa continuar investindo na aplicação de rótulos de confidencialidade e políticas DLP. Além disso, estenda rótulos de confidencialidade e políticas DLP para aplicativos SaaS usando o Defender para Aplicativos de Nuvem.

Use os recursos a seguir para progredir com o Microsoft Purview.

Etapa 4 – Aplicar o modelo de IA arriscado no IRM (Insider Risk Management)

O IRM (Gerenciamento de Risco Interno) do Microsoft Purview inclui modelos de política predefinidos que você pode aplicar ao seu ambiente, incluindo o uso de IA arriscado. Os modelos IRM são condições de política predefinidas que definem os tipos de indicadores de risco e o modelo de pontuação de risco usados pela política.

A política de uso de IA arriscada pode ajudar a detectar e habilitar a pontuação de risco para prompts e respostas em ferramentas de IA em sua organização. O IRM ajuda você a investigar e tomar medidas sobre atividades de risco relacionadas à IA.

Use os recursos a seguir para começar a usar o Insider Risk Management e aplicar o modelo de política de uso de IA arriscado.

| Tarefa | Recursos recomendados |

|---|---|

| Introdução ao Insider Risk Management e saiba mais sobre os principais cenários que beneficiam sua organização | Saiba mais sobre o gerenciamento de riscos internos |

| Aplicar o modelo de IA arriscado | Saiba mais sobre modelos de política de gerenciamento de risco interno | Microsoft Learn |

| Saiba mais sobre os principais cenários para IA e veja relatórios de exemplo | Gerenciamento de Risco Interno capacitando uma melhor visibilidade do uso arriscado de IA e investigações de segurança |

| Para aplicativos de IA desenvolvidos com o SDK do Purview, teste a integração do Insider Risk Management | Como testar um aplicativo de IA integrado ao SDK do Purview |

Etapa 5 – Configurar a Proteção Adaptável para o Gerenciamento de Risco Interno

A Proteção Adaptável no Gerenciamento de Riscos do Insider do Microsoft Purview atribui dinamicamente um nível de risco aos usuários e aplica políticas criadas a usuários com risco moderado ou elevado. As políticas podem implementar ações de prevenção contra perda de dados aumentadas, preservar conteúdo excluído ou impor requisitos de acesso condicional mais altos.

Use os recursos a seguir para começar a usar a Proteção Adaptável.

| Tarefa | Recursos recomendados |

|---|---|

| Introdução ao Insider Risk Management e saiba mais sobre os principais cenários que beneficiam sua organização | Saiba mais sobre o gerenciamento de riscos internos |

| Saiba mais sobre os principais cenários para IA e veja relatórios de exemplo | Gerenciamento de Risco Interno capacitando uma melhor visibilidade do uso arriscado de IA e investigações de segurança |

| Aplicar o modelo de IA arriscado | Saiba mais sobre os modelos de políticas de gestão de riscos internos |

| Investigar e agir sobre atividades de risco interno | Investigar atividades de gestão de riscos internos Tomar medidas sobre casos de gerenciamento de risco interno |

Aproveitar ao máximo a proteção contra ameaças para IA

O Defender para Aplicativos de Nuvem e o Defender para Nuvem incluem recursos para mantê-lo informado sobre o uso do novo aplicativo de IA e aplicar controles apropriados.

Etapa 1 – Usar o Defender para Aplicativos de Nuvem para fazer a triagem e proteger o uso de aplicativos de IA

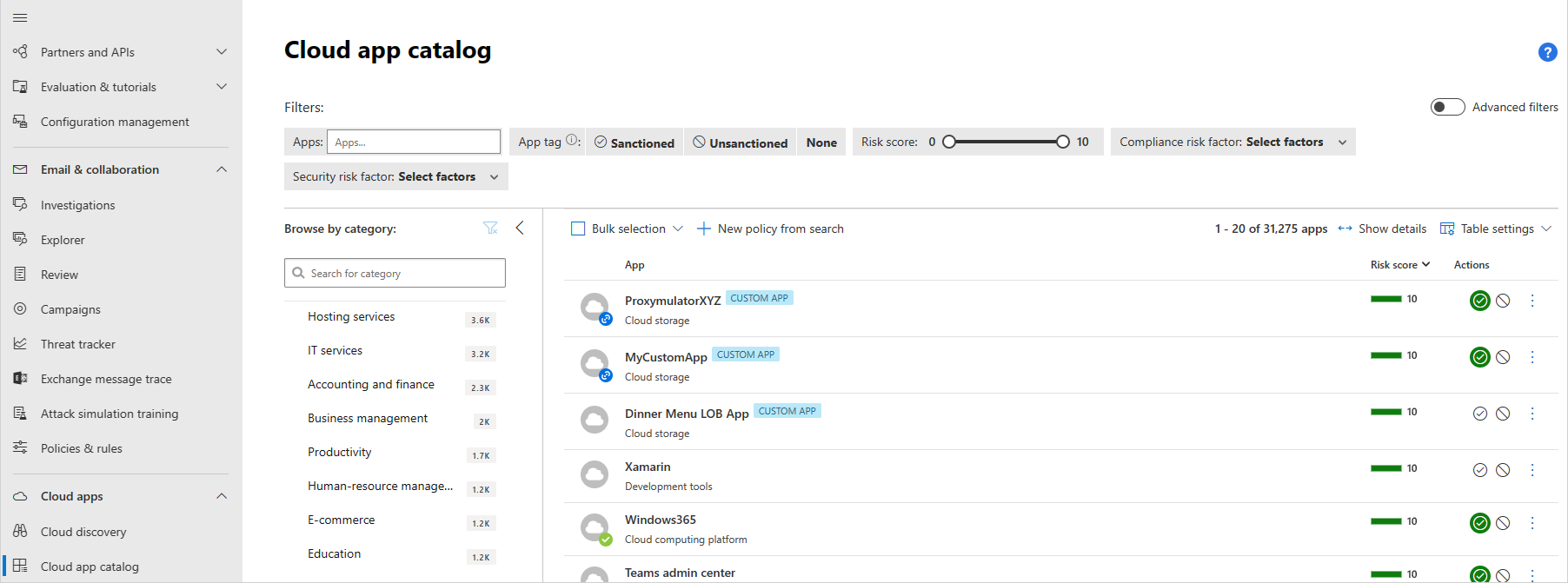

O artigo anterior desta série, Descobrir Aplicativos de IA e Dados, se concentrou no uso do Defender para Aplicativos de Nuvem para descobrir aplicativos de IA em seu ambiente. Este artigo incentiva as organizações a usar o Defender para Aplicativos de Nuvem para se manterem em cima do novo uso de aplicativo de IA avaliando o risco que isso representa para seu ambiente, sancionando ou bloqueando esses aplicativos e aplicando controles de sessão a aplicativos.

Primeiro, crie uma política para disparar automaticamente um alerta quando um novo aplicativo de IA do Generative estiver sendo usado em sua organização.

Em seguida, avalie a pontuação de risco para aplicativos recém-descobertos. Você também pode personalizar a pontuação de risco. Por exemplo, as organizações altamente regulamentadas podem querer alterar o peso de atributos específicos da pontuação de risco. Você também pode substituir uma pontuação de risco.

Decida se deseja sancionar ou bloquear cada aplicativo. As organizações podem optar por bloquear o uso de aplicativos por vários motivos. Alguns estão preocupados que dados confidenciais sejam compartilhados sem saber com aplicativos e expostos posteriormente a um público fora da organização. Isso pode fazer com que a organização bloqueie o uso de todos os aplicativos de IA não gerenciados. Embora outras organizações precisem garantir que todos os aplicativos em uso estejam em conformidade de acordo com padrões diferentes, como SOC2 ou HIPAA.

Por fim, para aplicativos que você sanciona, decida se deseja aplicar políticas de sessão para maior controle e visibilidade. As políticas de sessão permitem-lhe aplicar parâmetros à forma como as aplicações na cloud são utilizadas pela sua organização. Por exemplo, você pode configurar uma política de sessão que permite que apenas dispositivos gerenciados acessem um aplicativo de IA. Um exemplo mais simples pode ser configurar uma política para monitorizar o tráfego de dispositivos não geridos para que possa analisar o risco deste tráfego antes de aplicar políticas mais rigorosas.

Nesta ilustração:

- O acesso a aplicações na cloud aprovadas a partir de utilizadores e dispositivos na sua organização é encaminhado através de Defender para Aplicativos de Nuvem onde as políticas de sessão podem ser aplicadas a aplicações específicas.

- Os aplicativos de nuvem que você não sancionou ou não sancionou explicitamente não são afetados.

Além disso, o Defender para Aplicativos de Nuvem fornece detecções dedicadas para o Microsoft 365 Copilot. As equipes de segurança podem detectar interações suspeitas de um usuário com o Copilot e responder e atenuar a ameaça. Por exemplo, quando um usuário acessa dados confidenciais por meio do Copilot de um endereço IP arriscado, o Defender para Aplicativos de Nuvem dispara um alerta para sinalizar essa atividade suspeita com detalhes importantes, incluindo a técnica de ataque MITRE, o endereço IP e outros campos que as equipes de segurança podem usar para investigar ainda mais esse alerta.

Use os recursos a seguir como próximas etapas.

| Tarefa | Recursos recomendados |

|---|---|

| Examinar as etapas 5-8 neste fluxo de implantação do Defender para Aplicativos de Nuvem | Descobrir e gerir aplicações na cloud |

| Examine este tutorial de vídeo sobre como gerenciar aplicativos | Descobrir quais aplicativos de IA generativos são usados em seu ambiente usando o Defender para aplicativos de nuvem – YouTube |

| Criar uma política de descoberta de aplicativo | Criar políticas de deteção de cloud |

| Avaliar a pontuação de risco para aplicativos recém-descobertos | Pontuações de risco e catálogo de aplicativos de nuvem |

| Sancionar ou bloquear novos aplicativos | Gerencie aplicativos detectados |

| Aplicar políticas de sessão a aplicativos de IA para maior controle e visibilidade | Criar políticas de sessão |

| Saiba como usar a proteção contra ameaças para o Microsoft 365 Copilot | Novas detecções de ameaças para o Microsoft Copilot para Microsoft 365 |

Etapa 2 – Aplicar proteções de IA no Defender para Nuvem

O artigo anterior desta série, Descobrir aplicativos e dados de IA, se concentrou na descoberta de cargas de trabalho e modelos de IA geradores em execução em seu ambiente. Este artigo se concentra na proteção de aplicativos GenAI em todo o ciclo de vida do aplicativo, à medida que você cria e usa seus aplicativos de IA personalizados.

As organizações estão optando por desenvolver novos aplicativos GenAI e inserir IA em aplicativos existentes para aumentar a eficiência e a produtividade dos negócios. Os invasores estão cada vez mais buscando explorar aplicativos para alterar a finalidade projetada do modelo de IA com novos ataques, como injeções rápidas, ataques de carteira, roubo de modelo e envenenamento de dados, ao mesmo tempo em que aumentam a suscetibilidade a riscos conhecidos, como violações de dados e negação de serviço. As equipes de segurança precisam estar preparadas e garantir que tenham os controles de segurança adequados para seus aplicativos de IA e detecções que resolvam o novo cenário de ameaças.

O Microsoft Defender para Nuvem ajuda as organizações a proteger seus ambientes híbridos e multinuvem de código para nuvem. O Defender para nuvem inclui a postura de segurança e os recursos de proteção contra ameaças para permitir que as organizações protejam seus aplicativos GenAI criados pela empresa durante todo o ciclo de vida do aplicativo:

- Descubra continuamente componentes de aplicações GenAI e artefatos de IA, desde o código até a nuvem.

- Explore e corrija riscos nos aplicativos de GenAI com recomendações integradas para fortalecer a segurança.

- Identifique e corrija combinações tóxicas em aplicativos GenAI usando a análise do caminho de ataque.

- Detecte nos aplicativos GenAI alimentados por escudos de prompt de Segurança de Conteúdo da IA do Azure, sinais de inteligência de ameaças da Microsoft e monitoramento de atividade contextual.

- Pesquise e investigue ataques em aplicativos GenAI com integração interna com o Microsoft Defender.

Comece com os recursos de gerenciamento de postura de segurança com IA no Gerenciamento de Postura de Segurança na Nuvem do Defender (CSPM). O Defender CSPM descobre automaticamente e continuamente cargas de trabalho de IA implantadas com visibilidade granular e sem agente na presença e nas configurações de modelos de IA, SDKs e tecnologias usadas em serviços de IA, como o Serviço OpenAI do Azure, o Azure Machine Learning e o Amazon Bedrock.

O CSPM apresenta continuamente problemas de segurança contextualizados e sugere recomendações de segurança baseadas em risco personalizadas para priorizar lacunas críticas em suas cargas de trabalho de IA. Recomendações de segurança relevantes também aparecem no próprio recurso do Azure OpenAI no portal do Azure, fornecendo aos desenvolvedores ou proprietários de carga de trabalho acesso direto às recomendações e ajudando a corrigir mais rapidamente.

A funcionalidade de análise de caminho de ataque pode identificar riscos sofisticados para cargas de trabalho de IA, incluindo cenários de segurança de dados em que dados de aterramento ou ajuste fino são expostos à Internet por meio da movimentação lateral e são suscetíveis a envenenamento de dados.

Em seguida, mantenha-se seguro em tempo de execução com proteção contra ameaças para cargas de trabalho de IA. O Defender para Nuvem inclui proteção contra ameaças para cargas de trabalho de IA. A proteção contra ameaças para IA usa a integração nativa do Serviço Azure OpenAI, os escudos de prompt de Segurança de Conteúdo da IA do Azure e a inteligência contra ameaças da Microsoft para fornecer alertas de segurança contextuais e acionáveis. A proteção contra ameaças para cargas de trabalho de IA permite que as equipes de segurança monitorem seus aplicativos do Azure OpenAI em tempo de execução para atividades mal-intencionadas associadas a ataques diretos e indiretos de injeção de prompt, vazamentos de dados confidenciais e envenenamento de dados, bem como abuso de carteiras ou ataques de negação de serviço.

Use os recursos a seguir para as próximas etapas.

| Tarefa | Recursos recomendados |

|---|---|

| Examinar os principais cenários descritos neste blog | Proteger aplicativos de IA generativos com o Microsoft Defender para Nuvem |

| Usar o CSPM para obter visibilidade dos riscos de IA em seu ambiente | Proteger seus recursos com o Defender CSPM Examinar o painel de segurança de dados e IA (versão prévia) |

| Habilitar a proteção contra ameaças para cargas de trabalho de IA (versão prévia) | Habilitar a proteção contra ameaças para cargas de trabalho de IA (versão prévia) Alertas para cargas de trabalho de IA (versão prévia) |

Próxima etapa para proteger a IA

Depois de proteger aplicativos e dados de IA em sua organização, a próxima etapa é controlar os aplicativos de IA para atender aos requisitos de conformidade regulatória:

- Avalie e fortaleça sua postura de conformidade em relação às regulamentações.

- Implemente controles para controlar o uso de dados e aplicativos de IA.

Confira o próximo artigo desta série: Como reger a IA para conformidade?